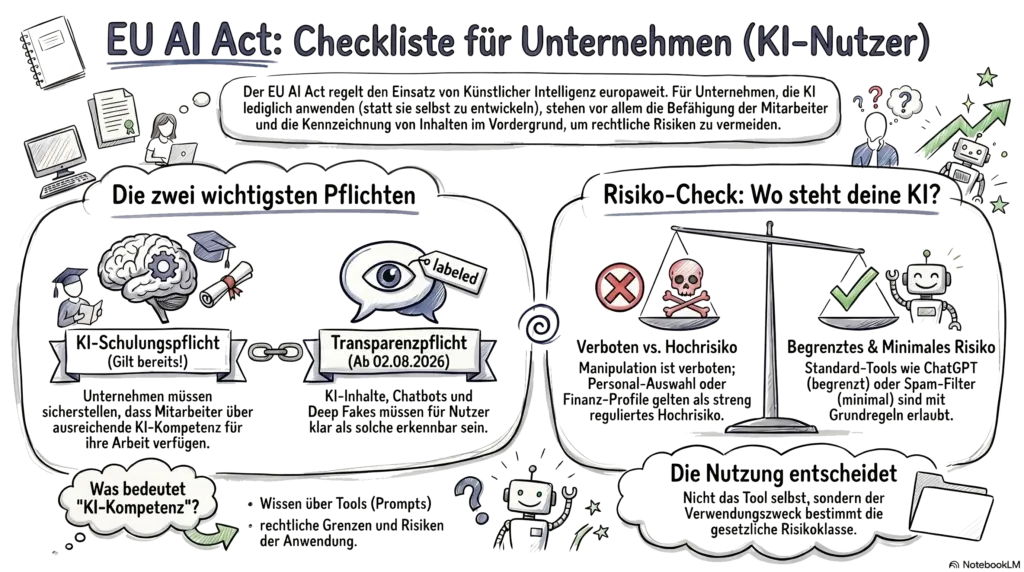

Nutzt du beruflich KI, oder nutzen andere in deinem Unternehmen Systeme wie ChatGPT oder Copilot? Die Antwort lautet vermutlich ja – damit gelten die Vorschriften aus dem „AI Act“ der EU. Das führt bereits jetzt zu Schulungspflichten. Ab August 2026 ist auch die Kennzeichnung von KI vorgeschrieben.

AI Act: ein EU-weit gültiges KI-Gesetz

Es gibt ein EU-weites Gesetz zur Künstlichen Intelligenz. Der AI Act, auch KI-Gesetz oder KI-Verordnung genannt, gilt nicht nur für Unternehmen, die KI-Technologie auf den Markt bringen. Er betrifft dein Unternehmen auch, wenn dort KI genutzt wird – wenn also beispielsweise ChatGPT die Marketing-Texte vorformuliert, Perplexity bei der Recherche und Claude beim Code hilft oder Canva Grafiken für die Website liefert.

Das „Gesetz über künstliche Intelligenz“ (Verordnung (EU) 2024/1689) wurde schon im Mai 2024 verabschiedet, übrigens als erstes KI-Gesetz weltweit. Bisher ist erst ein Teil der Bestimmungen in Kraft getreten. Im August 2026 kommt ein Großteil der weiteren Regelungen hinzu. Die letzten Vorgaben werden ab August 2027 wirksam.

Auf einen Blick:

Wenn in deinem Unternehmen KI nur genutzt wird, sind vor allem diese zwei Vorgaben aus dem AI Act wichtig:

- KI-Schulungspflicht: Unternehmen sollen die KI-Kompetenz ihrer Mitarbeiter sicherstellen, wenn diese mit Künstlicher Intelligenz arbeiten. Diese Vorschrift gilt bereits.

- Transparenzpflicht: Mit KI erstellte Inhalte und Dialoge müssen in vielen Fällen gekennzeichnet werden. Das gilt besonders für Chatbots sowie für Deep Fakes, die man für menschliche Kommunikation beziehungsweise für echte Darstellungen halten könnte. Diese Regelung tritt am 02. August 2026 in Kraft.

Falls dein Unternehmen eigene KI-Angebote entwickelt und vermarktet oder „Hochrisiko-KI“ nutzt, kommen weitere wichtige Vorschriften hinzu.